Wenn die eigene Stimme zur Waffe wird: Der Aufstieg von KI-gestütztem Audio-Betrug

Lange Zeit waren Phishing-Mails mit schlechter Grammatik das Hauptwerkzeug von Cyberkriminellen. Doch mit dem rasanten Fortschritt der generativen Künstlichen Intelligenz (KI) hat sich das Bedrohungspotenzial dramatisch gewandelt. Heute reicht ein kurzer Audio-Schnipsel aus, um die Stimme eines normalen Menschen täuschend echt zu klonen.

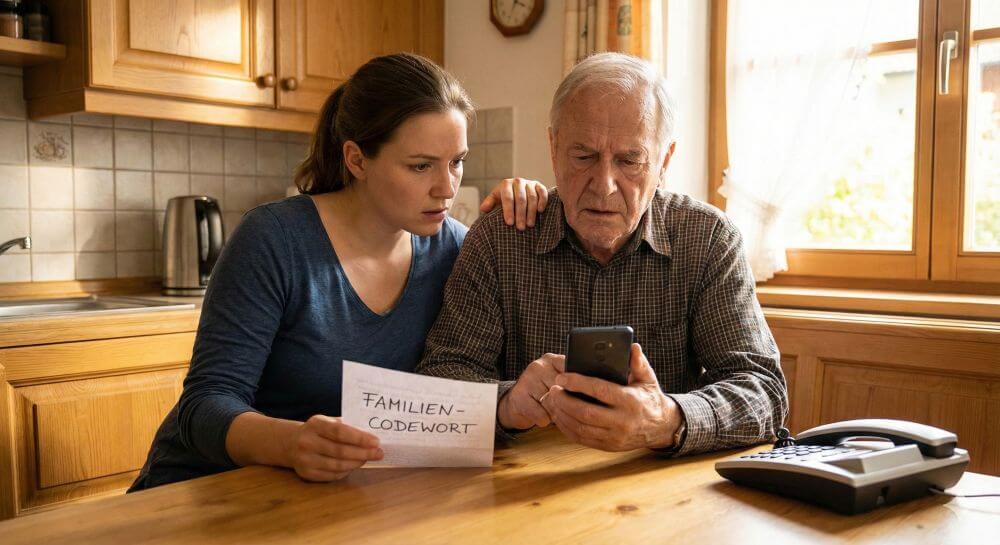

Das Phänomen, bekannt als „Voice Cloning“ oder „Deepfake Audio“, revolutioniert Betrugsmaschen wie den klassischen Enkeltrick.

Die Technologie: Drei Sekunden reichen aus

Woher die Betrüger Ihre Stimme haben

Die Betrugsszenarien

Statistiken und Risikowahrnehmung

Wie man sich schützt

Beliebte Beiträge

Die digitale Unterschrift in Outlook und Word

So unterschreiben Sie mit einer digitalen Signatur in Microsoft Word und Outlook und schaffen so mehr Vertrauen beim Empfänger.

Die besten Tipps für Microsoft Word

Sparen Sie mit diesen Tipps für Microsoft Word viel Zeit und Nerven. Arbeiten Sie effektiver mit der beliebtesten Textverarbeitungssoftware.

So funktioniert die bedingte Formatierung in Excel

So funktioniert die bedingte Formatierung in Microsoft Excel und bietet vielfältige Möglichkeiten für die Darstellung von Daten.

Briefvorlagen mit Formularfeldern in Word erstellen

Erstellen Sie einfach Ihre eigenen Formulare in Word durch den Einsatz von Steuerelementen die sich frei konfigurieren lassen.

Die besten Tipps für Excel – Leitfaden

Diese 10 Tipps zu Microsoft Excel 2016/2019 mit Fragen die viele Anwender täglich stellen werden Ihnen garantiert weiterhelfen, und eine Menge Zeit ersparen.

Schriftarten in Word durch Google Fonts erweitern

Erweitern sie mit wenigen Schritten die Auswahl an Schriftarten in Word ganz einfach indem Sie die Vielfalt von Google Fonts verwenden.