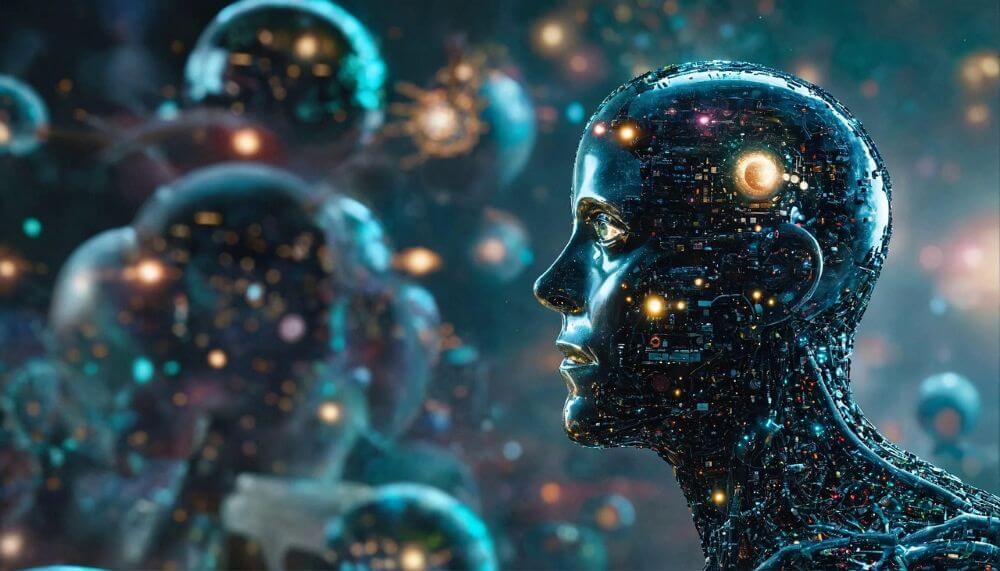

Warum KI-Chatbots so oft falsch liegen:

Ein Blick hinter die Kulissen der künstlichen Intelligenz

Sie sind die neuen Superstars der digitalen Welt: KI-Chatbots wie ChatGPT, Gemini und Co. Sie können Gedichte schreiben, Code programmieren, komplexe Themen zusammenfassen und auf fast jede Frage eine Antwort geben. Doch bei aller Begeisterung macht sich schnell Ernüchterung breit, wenn man feststellt: Die Antworten sind erstaunlich oft fehlerhaft, irreführend oder sogar komplett erfunden.

Doch warum ist das so? Wenn diese Modelle mit dem Wissen des gesamten Internets trainiert wurden, sollten sie dann nicht alles wissen? Die Antwort liegt in der grundlegenden Funktionsweise dieser Technologie und den Daten, mit denen sie gefüttert wird.

1. Das Kernproblem: KI „denkt“ nicht, sie rechnet

Der vielleicht größte Irrtum im Umgang mit KI-Chatbots ist die Annahme, sie würden die Welt verstehen, Fakten kennen oder ein Bewusstsein besitzen. Das tun sie nicht.

Im Kern sind sogenannte Große Sprachmodelle (Large Language Models, LLMs) gigantische statistische Werkzeuge. Sie wurden mit riesigen Textmengen aus dem Internet trainiert und haben dabei gelernt, Muster in der Sprache zu erkennen. Wenn Sie eine Frage stellen, „denkt“ die KI nicht über die Antwort nach. Stattdessen berechnet sie, welches Wort statistisch gesehen am wahrscheinlichsten auf Ihre Eingabe und die bisher generierten Wörter folgt.

Beispiel: Fragt man „Die Hauptstadt von Frankreich ist…“, hat die KI in ihren Trainingsdaten billionenfach den Satz „Die Hauptstadt von Frankreich ist Paris“ gesehen. Die Wahrscheinlichkeit, dass „Paris“ das nächste Wort ist, ist extrem hoch.

Das Problem: Das System ist darauf optimiert, eine flüssige, plausible und grammatikalisch korrekte Antwort zu generieren – nicht notwendigerweise eine wahre Antwort. Wenn eine falsche Information plausibel klingt und oft genug in den Trainingsdaten vorkam, wird die KI sie selbstbewusst wiedergeben.

2. Das Phänomen der „Halluzinationen“

Dieser statistische Ansatz führt direkt zum bekanntesten Problem von KI-Chatbots: den sogenannten „Halluzinationen“. Damit ist das Erfinden von Fakten, Quellen, Zitaten oder Ereignissen gemeint, die überzeugend klingen, aber jeder Grundlage entbehren.

Wenn die KI keine genaue Antwort in ihren Datenmustern findet oder Wissenslücken hat, füllt sie diese einfach mit den wahrscheinlichsten Wortkombinationen. Sie erfindet dann:

- Quellen: Sie listet wissenschaftliche Studien oder Artikel auf, die es nie gab.

- Zitate: Sie legt historischen Persönlichkeiten Worte in den Mund, die diese nie gesagt haben.

- Fakten: Sie erfindet Details zu Ereignissen oder Biografien.

Das Tückische daran: Die KI präsentiert diese Erfindungen mit derselben Autorität und demselben selbstsicheren Tonfall wie korrekte Fakten. Sie signalisiert fast nie, dass sie sich unsicher ist oder eine Information nur rät.

3. „Müll rein, Müll raus“: Die Grenzen der Trainingsdaten

Ein KI-Modell ist immer nur so gut wie die Daten, mit denen es trainiert wurde. Das Internet ist jedoch kein Hort reiner, verifizierter Fakten. Es ist voll von Meinungen, Vorurteilen, veralteten Informationen und bewussten Falschmeldungen.

Veraltetes Wissen: Die meisten großen Modelle haben einen „Wissensstopp“ – ein Datum, bis zu dem ihre Trainingsdaten reichen. Fragt man sie nach Ereignissen, die danach passiert sind, können sie entweder keine Antwort geben oder (schlimmer) sie versuchen zu raten und halluzinieren.

Vorurteile (Bias): Die KI lernt aus Texten, die von Menschen geschrieben wurden – mitsamt all unserer impliziten und expliziten Vorurteile. Wenn in den Trainingsdaten bestimmte Gruppen über- oder unterrepräsentiert sind oder mit Stereotypen behaftet werden, übernimmt die KI diese Muster.

Fehlerhafte Daten: Wenn eine Falschinformation im Internet oft genug wiederholt wird (z. B. eine populäre Verschwörungstheorie oder ein historischer Mythos), lernt die KI dieses Muster als „wahrscheinlich“ und gibt es als Fakt wieder.

4. Fehlendes Kontext- und Weltverständnis

Ein Mensch versteht den Kontext einer Frage. Wir verstehen Ironie, Subtext und die physische Welt um uns herum. Eine KI tut das nicht. Sie verarbeitet nur Text.

Wenn eine Eingabe mehrdeutig ist, kann die KI den gemeinten Kontext leicht missverstehen. Sie verfügt über kein echtes „Weltwissen“ oder gesunden Menschenverstand, um zu beurteilen, ob eine generierte Antwort logisch oder physisch überhaupt möglich ist. Sie kann Ihnen erklären, wie man ein Ei kocht, aber sie „weiß“ nicht, was ein Ei ist, was Hitze ist oder warum man Wasser braucht.

Fazit: KI ist ein mächtiges Werkzeug, kein Orakel

KI-Chatbots sind beeindruckende Werkzeuge für Kreativität, Zusammenfassungen und das Finden von Mustern. Sie sind jedoch keine unfehlbaren Wissensdatenbanken. Ihre Fehler sind kein „Betriebsunfall“, sondern systembedingt. Sie entstehen aus ihrer statistischen Natur, ihrem Mangel an echtem Verständnis und den unvermeidlichen Mängeln in ihren Trainingsdaten.

Für Nutzer bedeutet das vor allem eines: Misstrauen Sie blindem Vertrauen. Jede Antwort eines KI-Chatbots, insbesondere wenn es um Fakten, Zahlen, medizinische Ratschläge oder historische Daten geht, muss kritisch hinterfragt und mit verlässlichen Quellen überprüft werden.

Beliebte Beiträge

Word-Formatierungen endlich im Griff – Tutorial

Verzweifeln Sie nicht an zerschossenen Word-Dokumenten! Dieser Leitfaden zeigt Ihnen, wie Sie hartnäckige Formatierungen löschen, Formatvorlagen richtig nutzen und Steuerzeichen lesen. So sparen Sie Zeit und Nerven bei der Textverarbeitung.

Passwort für Word- und Excel-Dateien vergessen: So retten Sie Ihre Daten

Ein vergessenes Passwort bei Word oder Excel ist ärgerlich, bedeutet aber nicht immer Datenverlust. Während sich Schreibschutz durch einen XML-Trick umgehen lässt, erfordern verschlüsselte Dateien spezielle Tools. Hier finden Sie alle Lösungen im Überblick.

Excel KI-Update: So nutzen Sie Python & Copilot

Vergessen Sie komplexe Formeln! Excel wird durch Python und den KI-Copilot zum intelligenten Analysten. Diese Anleitung zeigt konkrete Beispiele, wie Sie Heatmaps erstellen, Szenarien simulieren und Ihre Arbeit massiv beschleunigen. Machen Sie Ihre Tabellen fit für die Zukunft.

Der XVERWEIS: Der neue Standard für die Datensuche in Excel

Verabschieden Sie sich vom Spaltenzählen! Der XVERWEIS macht die Datensuche in Excel endlich intuitiv und sicher. Erfahren Sie in diesem Tutorial, wie die Funktion aufgebaut ist, wie Sie sie anwenden und warum sie dem SVERWEIS und WVERWEIS haushoch überlegen ist.

Nie wieder Adressen abtippen: So erstellen Sie Serienbriefe in Word

Müssen Sie hunderte Briefe versenden? Schluss mit manuellem Abtippen! Erfahren Sie, wie Sie in wenigen Minuten einen perfekten Serienbrief in Word erstellen. Von der sauberen Excel-Datenbank bis zum fertigen Druck – unser Guide führt Sie sicher durch den Prozess.

Warum dein Excel-Kurs Zeitverschwendung ist – was du wirklich lernen solltest!

Hand aufs Herz: Wann hast du zuletzt eine komplexe Excel-Formel ohne Googeln getippt? Eben. KI schreibt heute den Code für dich. Erfahre, warum klassische Excel-Trainings veraltet sind und welche 3 modernen Skills deinen Marktwert im Büro jetzt massiv steigern.